M1 BBS ACP

From silico.biotoul.fr

m (→Analyse en composantes principales) |

m (→Recherche de \Delta_1 passant par G d'inertie minimum) |

||

| Line 127: | Line 127: | ||

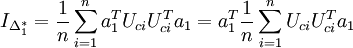

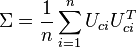

| - | on reconnaît la matrice de variance-covariance <math>\ | + | on reconnaît la matrice de variance-covariance <math>\Sigma = \frac{1}{n} \sum_{i=1}^n U_{ci} U_{ci}^T</math> |

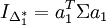

| - | donc <math>I_{\Delta_1^*} = a_1^T \ | + | donc <math>I_{\Delta_1^*} = a_1^T \Sigma a_1</math> |

| Line 137: | Line 137: | ||

| - | D'où la recherche du maximum : trouver <math>a_1</math> tel que <math>a_1^T \ | + | D'où la recherche du maximum : trouver <math>a_1</math> tel que <math>a_1^T \Sigma a_1</math> soit maximum (recherche l'optimum d'une fonction à plusieurs variables) |

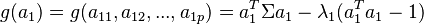

| - | <math>g(a_1) = g( a_{11}, a_{12}, ..., a_{1p}) = a_1^T \ | + | <math>g(a_1) = g( a_{11}, a_{12}, ..., a_{1p}) = a_1^T \Sigma a_1 - \lambda_ç1(a_1^Ta_1 -1) </math> |

<math>\rightarrow</math> d'après la méthode des multiplicateurs de Lagrange | <math>\rightarrow</math> d'après la méthode des multiplicateurs de Lagrange | ||

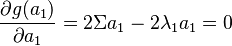

| - | <math>\rightarrow</math> | + | <math>\rightarrow</math> dérivées partielles de <math>g(a_1)</math>, en utilisant la dérivée matricielle |

| - | <math>\frac{\partial g(a_1)}{\partial a_1} = 2 \ | + | <math>\frac{\partial g(a_1)}{\partial a_1} = 2 \Sigma a_1 - 2 \lambda_1a_1 = 0</math> |

| Line 153: | Line 153: | ||

<math> | <math> | ||

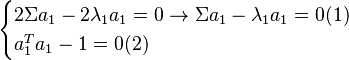

\begin{cases} | \begin{cases} | ||

| - | 2 \ | + | 2 \Sigma a_1 - 2 \lambda_1a_1 = 0 \rightarrow \Sigma a_1 - \lambda_1 a_1 = 0 (1)\\ |

a_1^T a_1 - 1 = 0 (2)\\ | a_1^T a_1 - 1 = 0 (2)\\ | ||

\end{cases} | \end{cases} | ||

| Line 159: | Line 159: | ||

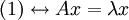

| - | <math>(1) \leftrightarrow A x = \lambda x</math> ou <math>\ | + | <math>(1) \leftrightarrow A x = \lambda x</math> ou <math>\Sigma a_1 = \lambda_1 a_1</math> d'où <math>a_1</math> vecteur propre de <math>\Sigma</math> associé à la valeur propre <math>\lambda_1</math> |

En multipliant à gauche par <math>a_1^T</math> on a | En multipliant à gauche par <math>a_1^T</math> on a | ||

| - | <math>a_1^T \ | + | <math>a_1^T \Sigma a_1 = a_1^T \lambda_1 a_1 = \lambda_1 a_1^T a_1</math> avec <math>(2)</math> on <math> = I_{\Delta_1^*}</math> que l'on cherche à maximiser. |

| - | Donc <math>\lambda_1</math> est la plus grande valeur propre de la matrice <math>\ | + | Donc <math>\lambda_1</math> est la plus grande valeur propre de la matrice <math>\Sigma</math> et <math>\lambda_1 = I_{\Delta_1^*}</math> |

Current revision as of 09:34, 8 October 2018

Contents |

Analyse en composantes principales

Objectif : Réduire le nombre de dimensions de l'espace d'observation = obtenir une projection en perdant un minimum d'informations.

Applications :

- grand nombre de variables que l'on cherche à visualiser en 2 à 3 dimensions

- dessin de graphes

Principe : trouver les axes sur lesquels on a un maximum de dispersion = plus de représentativité / moins de perte d'informations

Principe : trouver les axes sur lesquels on a un maximum de dispersion = plus de représentativité / moins de perte d'informations

Choix de l'origine

Prendre le centre de gravité du nuage.

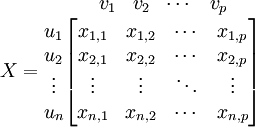

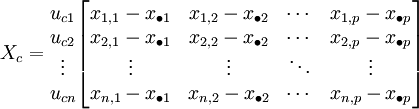

Données :

-

individus

individus  points dans l'espace à p dimensions.

points dans l'espace à p dimensions.

-

variables

variables

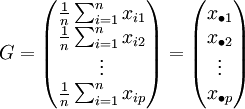

Centre de gravité :  avec pi le poids de chaque dimension

avec pi le poids de chaque dimension

On prendra G comme nouvelle origine.

données centrées

données centrées

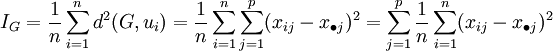

Mesure de dispersion : Inertie

Inertie par rapport à un point (le centre de gravité)

avec

on a

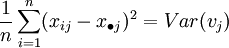

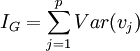

L'inertie par rapport au centre de gravité revient à la somme des variances de chaque variable

L'inertie par rapport au centre de gravité revient à la somme des variances de chaque variable

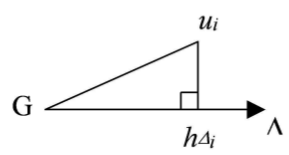

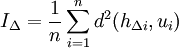

Inertie par rapport à un axe

mesure la proximité du nuage des individus à l'axe.

mesure la proximité du nuage des individus à l'axe.

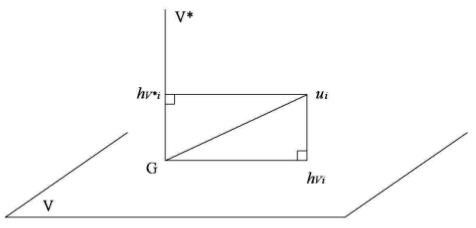

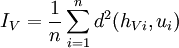

Inertie par rapport à un sous-espace vectoriel

C'est pareil.

C'est pareil.

Décomposition de l'inertie totale

V * le complémentaire orthogonal de V

on a

En projetant sur V, on perd l'inertie mesurée par IV et il ne reste plus que celle mesurée par

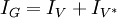

Recherche de Δ1 passant par G d'inertie minimum

maximise  avec

avec  vecteur unitaire de

vecteur unitaire de

donc

on reconnaît la matrice de variance-covariance

donc

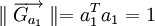

et  (vecteur unitaire)

(vecteur unitaire)

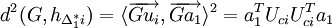

D'où la recherche du maximum : trouver a1 tel que  soit maximum (recherche l'optimum d'une fonction à plusieurs variables)

soit maximum (recherche l'optimum d'une fonction à plusieurs variables)

d'après la méthode des multiplicateurs de Lagrange

d'après la méthode des multiplicateurs de Lagrange

dérivées partielles de g(a1), en utilisant la dérivée matricielle

dérivées partielles de g(a1), en utilisant la dérivée matricielle

donc

ou Σa1 = λ1a1 d'où a1 vecteur propre de Σ associé à la valeur propre λ1

ou Σa1 = λ1a1 d'où a1 vecteur propre de Σ associé à la valeur propre λ1

En multipliant à gauche par  on a

on a

avec (2) on

avec (2) on  que l'on cherche à maximiser.

que l'on cherche à maximiser.

Donc λ1 est la plus grande valeur propre de la matrice Σ et